Unternehmen ist nicht gleich Unternehmen. In vielen Organisationen wird KI längst selbstverständlich genutzt, eingebettet in automatisierte Prozesse, Analyse-Tools oder Assistenzsysteme. Dort ist KI kein Hype mehr, sondern Infrastruktur.

Trotzdem sieht die Realität vielfach noch anders aus. KI wird als neu und schwer greifbar wahrgenommen. Nicht wegen der Technologie selbst, sondern wegen ihrer Auswirkungen auf Arbeit, Rollen und Verantwortlichkeiten. Diese Unsicherheit lässt sich weder durch Tool Demos noch durch technische Argumente auflösen. Die entscheidende Frage ist daher also nicht, welche Tools eingesetzt werden, sondern wie Menschen auf diese Veränderung vorbereitet werden. Wie also bereitet man ein Team auf die Einführung von KI-Tools vor?

Warum KI-Einführung kein IT-Projekt ist

KI scheitert in Unternehmen selten an der Technik. Die meisten Tools funktionieren, lassen sich integrieren und schnell bereitstellen. Was nicht funktioniert, ist die Annahme, dass sich damit automatisch bessere Arbeit ergibt. Denn KI greift nicht nur in Prozesse ein, sondern in Entscheidungslogiken. Wer bewertet Ergebnisse? Wer trägt Verantwortung? Und was gilt überhaupt als „gute Leistung“, wenn Vorschläge, Analysen oder Texte teilweise von Systemen stammen?

Für Mitarbeitende ist deshalb nicht entscheidend, wie ein KI-Tool bedient wird. Entscheidend ist, was sich dadurch für ihre Rolle verändert. Bleibt meine Expertise relevant? Werde ich ersetzt oder unterstützt? Und woran werde ich künftig gemessen?

Genau deshalb ist die Einführung von KI kein IT-Projekt, sondern eine Führungsaufgabe. Sie erfordert klare Entscheidungen darüber, wie Mensch und KI zusammenarbeiten sollen – und welche Verantwortung ausdrücklich beim Menschen bleibt.

Change Management: Wie entsteht Akzeptanz für KI?

Die erfolgreiche Einführung von KI baut auf zwei Säulen: auf sinnvollen Tools und auf einer klaren Organisationslogik. Studien wie das 10-20-70-Prinzip zeigen, dass der größte Hebel dabei nicht in Algorithmen oder Technologie liegt, sondern zu 70 Prozent bei Menschen und Prozessen (und nur zu 10 Prozent aus theoretischem Wissen). Akzeptanz entsteht dort, wo diese 70 Prozent bewusst gestaltet werden.

Warum ist Akzeptanz wichtig?

Ohne Akzeptanz bleibt KI wirkungslos. Tools sind vorhanden, prägen den Arbeitsalltag aber nicht. Es entstehen Kosten und zusätzlicher Aufwand, ohne dass sich Ergebnisse verbessern.

Akzeptanz ist zugleich eine Voraussetzung für Qualität und Sicherheit. KI liefert Vorschläge, keine Verantwortung. Ergebnisse müssen eingeordnet, geprüft und bewusst genutzt werden. Das gelingt weder bei Ablehnung noch bei unkritischer Übernahme. Akzeptanz bedeutet, KI als Werkzeug zu nutzen und Verantwortung klar beim Menschen zu belassen.

Kurz gesagt: Ohne Akzeptanz keine Nutzung. Ohne Nutzung keine Wirkung. Und ohne Wirkung kein sinnvoller Einsatz von KI.

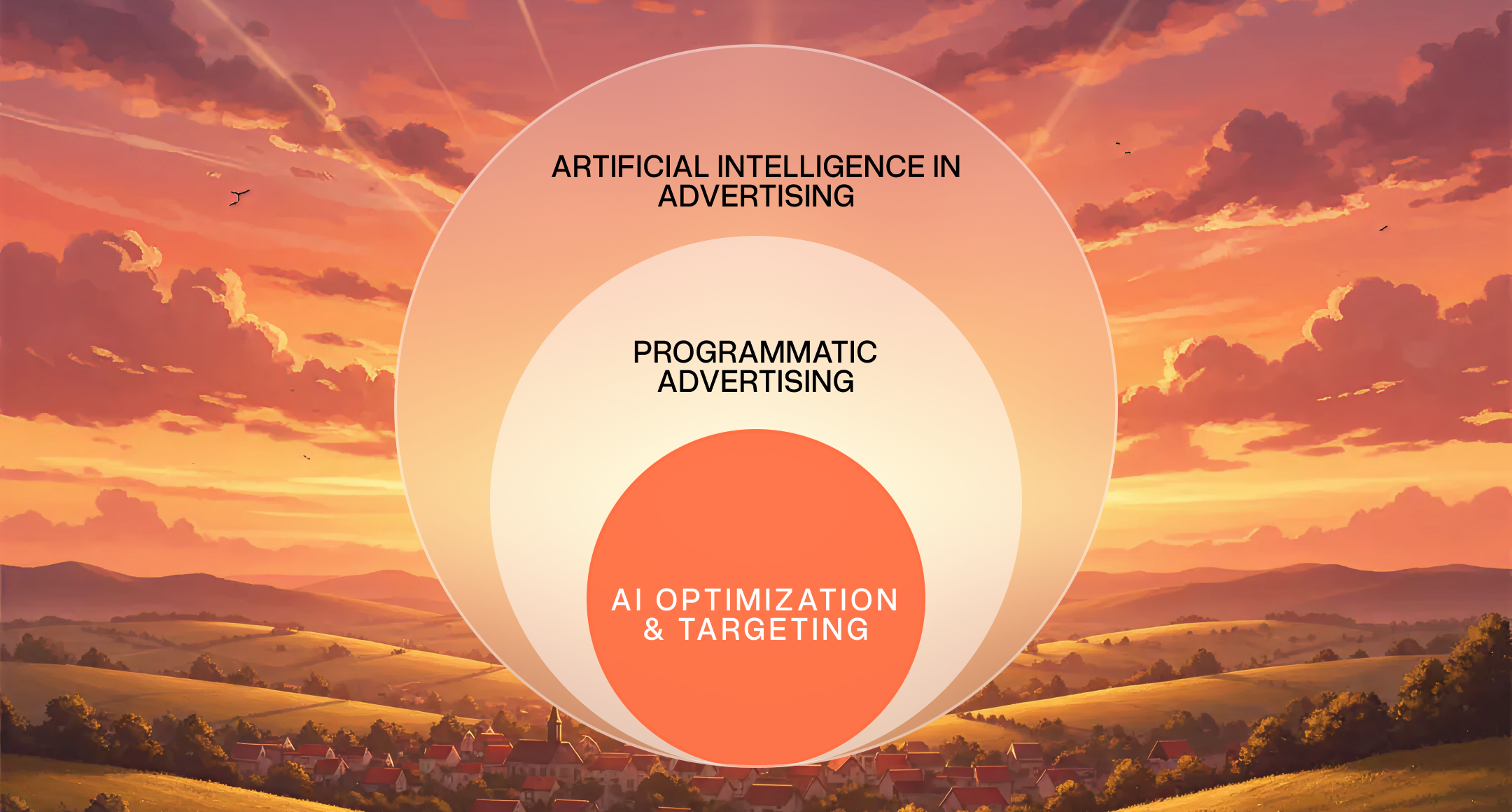

Wo Unternehmen KI heute konkret einsetzen

Unternehmen setzen KI in klar definierten Bereichen ein. Dazu zählen die Automatisierung von Routineaufgaben wie Dokumentenbearbeitung, Textklassifikation oder Standardreports sowie die Analyse großer Datenmengen für Prognosen, Risikoeinschätzungen oder Kundensegmentierung. KI unterstützt dabei Entscheidungen, trifft sie aber nicht.

Zunehmend wird auch generative KI genutzt, insbesondere für Content Creation. Sie hilft bei Entwürfen, Strukturierung und Ideengenerierung in Marketing, Kommunikation und internen Dokumenten. Diese konkreten Einsatzfelder erleichtern die Akzeptanz, weil der Nutzen schnell erkennbar ist und die Verantwortung klar beim Menschen bleibt.

Warum Tool-Schulungen allein nicht ausreichen

Wer KI im Arbeitsalltag nutzt, steht selten vor der Frage, welcher Button zu klicken ist. Entscheidend ist vielmehr, ob ein Ergebnis sinnvoll, plausibel und verantwortbar ist. Genau darauf bereiten klassische Tool-Schulungen kaum vor. Sie erklären Funktionen, aber nicht, wie Ergebnisse im Kontext von Prozessen und Entscheidungen zu bewerten sind.

KI erzeugt schnell überzeugende Ergebnisse. Texte klingen rund, Analysen wirken logisch, Vorschläge sind sauber formuliert. Das ist hilfreich, weil es Vorarbeit abnimmt. Gleichzeitig steigt damit die Verantwortung, Ergebnisse richtig einzuordnen. Ohne dieses Verständnis wird Produktivität leicht mit Qualität verwechselt.

Welche Kompetenzen wirklich zählen

Im Zusammenspiel mit klaren Prozessen kann KI ein sehr wirkungsvolles Werkzeug sein. Entscheidend ist, wie Teams mit KI-produzierten Ergebnissen umgehen. Kritisches Denken spielt dabei eine zentrale Rolle. Wer mit KI arbeitet, sollte nachvollziehen können, warum ein bestimmter Vorschlag oder eine bestimmte Vorgehensweise genutzt wird und ein anderer nicht. Das ist weniger eine technische Frage als eine Frage professioneller Arbeitsweise.

Genauso wichtig ist die Fähigkeit, KI als Unterstützung zu verstehen. Sie kann vorbereiten, strukturieren und verschiedene Optionen sichtbar machen. Die eigentliche Wertschöpfung entsteht dort, wo Menschen diese Vorarbeit nutzen, priorisieren und fundierte Entscheidungen treffen. Klarheit über Zuständigkeiten schafft dabei Sicherheit. Teams sollten wissen, wer entscheidet und wofür Verantwortung getragen wird.

Welche Regeln Unternehmen für KI brauchen

KI lässt sich produktiv nutzen, wenn der Rahmen stimmt. Klare Regeln schaffen dabei keine Einschränkung, sondern Sicherheit. Sie helfen Teams zu verstehen, was erlaubt ist, was nicht und worauf sie sich verlassen können. Genau das ist die Voraussetzung dafür, dass KI im Alltag genutzt wird und nicht zur Grauzone wird.

Datenschutz und DSGVO

Die DSGVO ist die verbindliche Grundlage für den Einsatz von KI im Unternehmen. Sie greift immer dann, wenn personenbezogene Daten verarbeitet oder in KI-Systeme eingegeben werden. Für den Arbeitsalltag heißt das vor allem: Es muss eindeutig geregelt sein, welche Daten genutzt werden dürfen und welche nicht.

Die fachliche Verantwortung für die Umsetzung der DSGVO liegt dort, wo KI eingesetzt wird. Der rechtliche Rahmen sollte zentral durch Datenschutz, Compliance oder Legal vorgegeben und regelmäßig überprüft werden. So bleibt Verantwortung klar verteilt und handhabbar.

EU AI Act

Der EU AI Act ergänzt die DSGVO um einen Ordnungsrahmen für KI. Er fordert Transparenz, Risikoeinordnung und klare Zuständigkeiten. Für Unternehmen bedeutet das keine grundsätzliche Einschränkung, sondern die Notwendigkeit, den Einsatz von KI bewusst zu steuern.

Die Verantwortung für die Einordnung liegt in der Regel bei einer zentralen Governance-Funktion, häufig angesiedelt zwischen IT, Legal und Fachbereichen. Entscheidend ist nicht der Titel, sondern ein klares Mandat zur Steuerung und Abstimmung.

Interne Richtlinien

Gesetze entfalten im Alltag nur Wirkung, wenn sie in klare interne Regeln übersetzt werden. Gute KI-Richtlinien sind kurz, verständlich und praxisnah. Sie definieren, welche Tools genutzt werden dürfen, welche Daten zulässig sind und wofür KI eingesetzt werden darf.

Erarbeitet werden sollten diese Richtlinien gemeinsam von Fachbereichen, IT und Compliance. Verantwortlich für ihre Anwendung sind die jeweiligen Führungskräfte. Damit wird klar: KI-Nutzung ist keine Einzelentscheidung, sondern Teil organisationaler Verantwortung.

Fazit: KI-Readiness ist Führungsarbeit

Die KI-Herausforderung ist nicht die Technologie. Es geht um Unklarheit, fehlende Entscheidungen, offene Verantwortlichkeiten und den Glauben, man könne Wandel delegieren. Unternehmen, die KI erfolgreich einsetzen, tun nichts Spektakuläres. Sie schaffen Orientierung, setzen klare Leitplanken und nehmen ihre Teams ernst.

KI-Readiness bedeutet also nicht, nur die richtigen Tools zu besitzen. Sie bedeutet, Entscheidungen zu treffen. Über Rollen, Verantwortung und Zusammenarbeit zwischen Menschen und Maschine. Wer diese Führungsarbeit leistet, wird erleben, dass KI kein Risiko ist, sondern ein Produktivitätshebel.

FAQs

Was bedeutet „KI-ready“ für ein Team?

Ein KI-ready Team versteht KI als Werkzeug zur Unterstützung von Arbeit und Entscheidungen, nicht als Ersatz für Verantwortung. Rollen, Zuständigkeiten und Qualitätsmaßstäbe sind klar definiert, und Ergebnisse aus KI-Systemen werden bewusst geprüft und eingeordnet.

Warum scheitert KI-Einführung häufig trotz funktionierender Tools?

Weil sich mit KI die Entscheidungslogiken verändern. Ohne Klarheit darüber, wer Ergebnisse bewertet, Verantwortung trägt und Qualität sichert, entstehen Unsicherheit, Zurückhaltung oder unkritische Nutzung – unabhängig von der technischen Leistungsfähigkeit der Tools.

Reichen Tool-Schulungen aus, um Teams auf KI vorzubereiten?

Nein. Tool-Schulungen vermitteln Funktionen, aber keine Bewertungskompetenz. Entscheidend ist nicht, wie ein Tool bedient wird, sondern wie KI-Ergebnisse im Kontext von Prozessen, Risiken und Entscheidungen eingeordnet werden.

Welche Rolle spielt Führung bei der KI-Einführung?

Eine zentrale. Führungskräfte geben Orientierung, definieren Verantwortlichkeiten und setzen Leitplanken für den Einsatz von KI. Ohne diese Klarheit bleibt KI entweder ungenutzt oder wird unkritisch übernommen.

Warum ist Akzeptanz im Team so wichtig?

Ohne Akzeptanz wird KI nicht genutzt oder falsch eingesetzt. Akzeptanz bedeutet nicht Zustimmung um jeden Preis, sondern ein klares Verständnis von Nutzen, Grenzen und Verantwortung beim Einsatz von KI.

Welche Kompetenzen brauchen Teams im Umgang mit KI?

Entscheidend sind kritisches Denken, Urteilskraft und Prozessverständnis. Teams müssen nachvollziehen können, warum KI-Vorschläge genutzt oder verworfen werden und wie sie zur eigenen Arbeit beitragen.

In welchen Bereichen wird KI heute sinnvoll eingesetzt?

Vor allem bei der Automatisierung von Routinetätigkeiten, der Analyse großer Datenmengen und der Vorbereitung von Entscheidungen. Generative KI wird häufig für Entwürfe, Strukturierung und Ideengenerierung genutzt – die finale Verantwortung bleibt beim Menschen.

Wie verhindert man unkritische Übernahme von KI-Ergebnissen?

Durch klare Regeln, definierte Qualitätskriterien und transparente Zuständigkeiten. KI liefert Vorschläge, keine Entscheidungen. Diese Trennung muss organisatorisch verankert sein.

Welche rechtlichen Rahmenbedingungen sind für Teams relevant?

Zentral sind die DSGVO und der EU AI Act. Sie regeln den Umgang mit personenbezogenen Daten, Transparenzanforderungen und Risikoklassen. Für Teams heißt das: Klarheit darüber, welche Daten und Tools zulässig sind und wer Verantwortung trägt.

Wer trägt die Verantwortung für KI-Ergebnisse?

Immer der Mensch. Auch wenn KI vorbereitet, analysiert oder formuliert – Verantwortung für die Ergebnisse liegen bei den ausführenden menschlichen Fachkräften.